吴师傅和那些不能交给 Agent 的节点

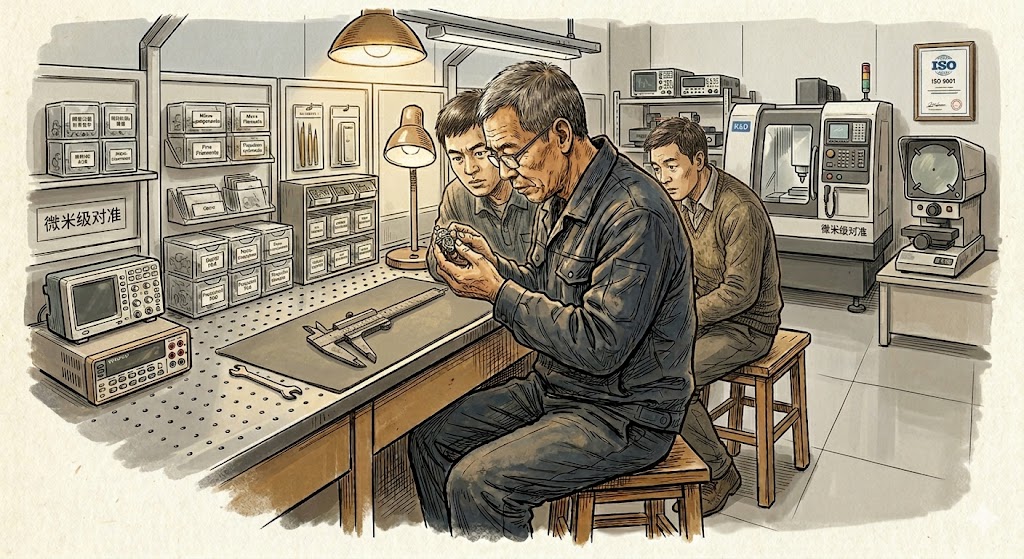

吴师傅的工位在精密装配工段的尽头,靠着一面没有窗户的混凝土墙。这个位置是他自己选的。1993 年他进厂的时候,带他的老师傅把他放在了车间正中间——人来人往,各种声音、振动、气流。老师说:"先在乱的地方练手。等你手上有了准头,再给你一个安静的位置。"五年后他有了准头,被调到了这个尽头工位。安安静静,只有他和零件。

精密装配是华岳精密最吃手艺的活。核心零部件的最终装配、高精度校准、异常品的再加工——这些工序的共同特点是:大部分情况有标准流程,但一旦碰到异常,标准流程不够用。

一个零件的公差在图纸范围内,但装配后的手感告诉吴师傅"有点紧"。这种"有点紧"说不清楚——不是数值超差,不是外观异常,是经验积累下来的一种直觉。这种直觉让他多做了一步——把零件拆开,重新清洗了一遍配合面。清洗之后再装,手感对了。

后来检测发现,那批零件的表面微观粗糙度确实偏高了一个等级。如果按标准流程直接装下去,成品在三个月后可能出现微动磨损。不是马上出问题,是隐患。吴师傅能感觉到这个隐患。他不知道怎么解释这件事,他说这叫"手感"。三十年练出来的手感。

三次自动化

厂里试过三次把他这个工位自动化。都没成。

第一次是 2008 年。厂里上了一台进口的精密装配机器人,号称可以替代"高精度手工装配"。机器人装了两周,良品率 95%。吴师傅手工装的良品率 99.2%。差了 4.2 个百分点。追查原因——机器人处理标准品没问题,但碰到异常品(公差在边界、表面有微观缺陷、配合间隙需要微调)时,它的处理方式是"报警停机"。标准品占 80%,异常品占 20%。那 20% 它不会处理。

第二次是 2015 年。厂里又上了一台,这次加了视觉检测和力控传感器。良品率做到了 97%。进步了,但还是不如吴师傅。因为视觉检测能看到的异常和力控传感器能感觉到的异常,加起来还是比吴师傅的"手感"少——他能察觉到那些视觉看不到、传感器量不出的细微问题。

第三次是 2020 年。这次不上机器人了,上了一套 AI 辅助判断系统——用视觉大模型识别异常,用算法给出处理建议。效果比前两次好,良品率到了 98%。但还是不如吴师傅。因为 AI 的建议是基于历史数据推断的——历史上没见过的异常,它要么给不出建议,要么给一个"看起来合理但实际有风险"的建议。

三次下来,厂里得出了一个结论:有些工序的"异常判断"没法完全程序化。 标准部分可以自动化,但异常部分必须有人兜着。吴师傅听了这个结论,说了一句:"机器做对了是应该的,做错了找谁说理?这种活儿就得有个人兜着。"

一个新的"徒弟"

去年冬天,郑总找吴师傅谈话。

"吴师傅,有个事想请你帮忙。"

厂里正在做一个贷款审批 Agent 系统——不是华岳精密自己的,是给一个合作的金融科技公司做的咨询。这家公司想用 AI 做贷款审批的自动化,把审批流程从"人工审"变成"AI 审+人工复核"。他们技术上能做,但不知道该在哪些环节设人工复核点。

"他们懂技术,但不懂'什么时候该让人来'。吴师傅,你在这个问题上干了三十年。"

吴师傅没立刻答应。他问了一个问题:"他们派谁来跟我对接?"

"一个年轻的数据科学家。名校硕士,做过好几个 AI 项目。"

吴师傅想了想:"行。但他得按我的规矩来。"

"什么规矩?"

"看三年,动手三年,独立三年。"

郑总愣了一下:"这是你带徒弟的规矩。一个咨询项目,不用三年吧?"

吴师傅说:"规矩是规矩。我没说一定要三年。但顺序不能变——先看,再动手,再独立。他来了不能一来就问我要结论,得先看我怎么做事。"

那个年轻的数据科学家叫方远,27 岁,某 985 高校计算机硕士,做过两个 NLP 项目和一个推荐系统。他被派到华岳精密"跟吴师傅学习",心里是有些不服气的——一个做精密机械的老工人,能教他什么关于 AI 风险判断的东西?

第一天,吴师傅让他在工位旁边搬了个凳子,坐下看。

"什么都不要问,不要记笔记,不要拿电脑。就看我干活。"

方远坐了一天。看吴师傅装配了七个零件。其中五个按标准流程顺利完成。第六个,吴师傅拆开重装了一次。第七个,吴师傅停下来看了很久,然后走到检测室拿来一台高倍率显微镜看了一遍,回来才装。

方远忍不住问:"吴师傅,第七个你为什么拿显微镜看?"

"手感不对。"

"什么手感?"

"我说不上来。就是不对。"

方远觉得这个回答不太科学。但他没说什么。

第二周,吴师傅开始让他做一些辅助工作——递零件、记录装配参数、帮忙拿检测报告。不是教他装配,是让他"离活儿近一点"。

第三周,吴师傅开始跟他解释装配背后的判断逻辑。不是一次讲完,是碰到什么讲什么。

一个零件公差在范围内,但吴师傅说"这个先放一边"。方远问为什么。吴师傅说:"你看这个配合面的纹理——它是斜的。正常应该是平行的纹理。斜的纹理说明加工的时候刀具走偏了。公差没超,但纹理不对,配合后可能有微观滑移。"

方远第一次意识到,吴师傅的"手感"不是玄学——是几十年积累的微观模式识别。只是这些模式没有被形式化,没有被写成文档,全在吴师傅的手和眼睛里。

第四周开始,吴师傅把话题从零件转向了贷款审批。

"你不是要给那个贷款审批系统设人工复核点吗?你先告诉我,你们的 Agent 怎么审贷款。"

方远解释了一遍流程:客户提交申请 → Agent 收集信息(收入、征信、负债)→ Agent 评估风险 → Agent 给出审批建议(批/不批/人工复核)→ 输出结果。

吴师傅听完,问了一个问题:"你的 Agent 什么时候会决定'这个案子要给人看'?"

"两种情况。一种是置信度低于阈值——Agent 自己不确定。另一种是触发了预设的高风险规则——比如贷款金额超过某个上限、客户有不良记录。"

"还有没有第三种?"

"什么第三种?"

"Agent 自己很确定,但实际搞错了的那种。"

方远愣了一下。"这种……我们的质量监控会抽样检查。但不能做到每个都拦。"

吴师傅点点头。"你刚才说我的第七个零件——公差在范围内,检测也合格,但我觉得不对,拿了显微镜看。如果那个零件是一台设备的配合件,公差和纹理都'合格',直接装上去,三个月后微动磨损,设备故障。谁负责?"

"设计的人?还是制造的人?"

"用这台设备的人负责承受后果。但他不是做决策的人。"吴师傅看着方远。"贷款审批也是一样。Agent 批了一个贷款,客户还不上,坏账了。谁承受后果?银行。谁做的决策?Agent。做决策的和承受后果的不是同一个人。这种时候,就得有人在中间兜着。"

哪些节点必须留人

接下来的两个月,吴师傅和方远一起,把贷款审批流程从头到尾走了一遍。不是从技术角度走,是从"出错了谁负责"的角度走。

吴师傅的方法很简单——对每个环节问三个问题:

第一,这个环节如果出错了,后果有多严重?

如果只是"审批慢了一点",后果轻,可以容忍。如果是"批了一个不该批的贷款导致大额坏账",后果重,不能容忍。

第二,这个环节出错了,能被发现吗?

如果错误会在后续环节自然暴露(比如下游审核会拦住),那可以依赖下游。如果错误一旦通过就再也发现不了(比如一个隐蔽的风险因素被忽略了),那必须在这个环节拦截。

第三,如果出错了,谁能兜住?

如果错误的影响范围可控、有人能补救,风险可接受。如果错误的影响不可逆、没有人能补救,必须在决策前拦截。

三个问题问完,每个环节得出一个判断:必须有人、可以自动化、看情况。

方远整理了两周,画了一张表。十五个审批环节里,三个标了"必须有人",五个标了"可以自动化",七个标了"看情况"。

"看情况"的那些,他设了条件规则——满足条件的走自动化,不满足的转人工。

吴师傅看了这张表,说:"差不多了。但我有一个补充。"

"什么?"

"你的'可以自动化'那五个环节——三个月后回来再看一遍。"

"为什么?"

"因为我当年也觉得有些装配步骤可以完全交给机器。后来发现,'可以自动化'这件事本身会过期——环境变了、产品变了、客户变了,原来安全的自动化可能变得不安全。所以你得定期回来重新评估。"

方远看着吴师傅,忽然明白了为什么郑总要派他来跟这个老师傅学。

吴师傅教他的不是"怎么设人工复核点"。吴师傅教他的是一个更根本的东西——人不是系统的 fallback,是系统的一部分。有些活儿不是机器做不了,是不该让机器做。哪些该让人做,是风险设计问题,不是技术问题。

三个月

三个月后,方远回去了。

临走之前,他给吴师傅带了一盒茶叶。吴师傅收了,放了一包在工位旁边的柜子里。

方远说:"吴师傅,我以前觉得 Human in the Loop 是一个技术方案——在自动化流程里加几个'确认'按钮。现在我知道不是。它是一个风险设计问题。谁来做决策、谁承受后果、谁能兜住——这三个问题答清楚了,才知道人该放在哪里。"

吴师傅点点头。

方远又说:"你那三个问题——后果有多严重、能不能被发现、谁能兜住——比我们用的任何风险评估框架都好使。"

吴师傅没接话。他从柜子里拿出一把旧游标卡尺,递给方远。

"这是我师傅给我的。1993 年。现在我用不上了——我早换数显的了。但你拿着。"

方远接过来。卡尺的刻度已经有些磨损,但滑动还顺滑。

"记住了,"吴师傅说,"工具换了三代,但'什么活儿该让机器做、什么活儿该让人做'这个问题,三十年没变过。"

方远走的那天下午,吴师傅回到工位,继续装他的零件。

旁边的凳子空了。但他知道,这张凳子不会空太久——他的徒弟里有一个是小刘的堂哥,明年要开始跟他学手艺了。

带徒弟的方式还是那个方式:看三年,动手三年,独立三年。

只不过这次"看"的东西,多了一样——不仅要看零件,还要看系统。

相关手记

郑总 55 岁,从基层干到副总。他不写代码,但要决定工厂怎么建 AI——什么时候招什么人、每月 token 烧多少钱、哪些 Agent 的 ROI 为正。前面七个工位的故事在这里汇合,他要拼出一座能算清账的工厂。

小刘盯仪表盘三年。厂里 Agent 系统上线两个月没人做可观测性——他不知道哪个 Agent 每天烧多少钱、什么时候会挂。他用两周自己拼了块仪表盘,上线第一天就发现了一个没人注意到的问题。

王工管了十五年工厂安全。直到发现客服 Agent 在测试环境访问了财务系统——没人认为这是安全问题,他直接断网了。然后开始建一套"AI 版 HAZOP",依据不是 AI 安全框架,是十五年的 EHS 逻辑。